Discord kembali menuai kontroversi. Platform komunikasi populer itu menghadapi gelombang kritik setelah mengumumkan kebijakan baru yang mewajibkan seluruh pengguna memverifikasi usia untuk mengakses konten dewasa, dengan cara mengunggah video swafoto atau dokumen identitas resmi pemerintah.

Discord mengklaim kebijakan ini mengandalkan teknologi kecerdasan buatan (AI) yang bekerja langsung di perangkat pengguna. Sistem tersebut disebut mampu memperkirakan usia dengan menganalisis struktur wajah atau mencocokkan selfie dengan kartu identitas. Perusahaan menegaskan bahwa data video selfie tidak akan meninggalkan perangkat pengguna, sementara dokumen identitas yang diverifikasi di luar perangkat akan segera dihapus setelah proses estimasi usia selesai.

Dalam blog resminya, Discord menyebut kebijakan ini akan diterapkan melalui “peluncuran global bertahap” mulai awal Maret. Seluruh akun secara otomatis akan dialihkan ke pengalaman “ramah remaja” hingga pengguna menyelesaikan proses verifikasi usia. Untuk membuka konten sensitif atau masuk ke kanal berusia terbatas, mayoritas pengguna diperkirakan harus melalui proses tersebut.

Discord menyatakan sebagian besar pengguna hanya perlu melakukan verifikasi satu kali. Namun, dalam kondisi tertentu, pengguna bisa diminta menjalani lebih dari satu metode verifikasi jika sistem membutuhkan informasi tambahan untuk menentukan kelompok usia.

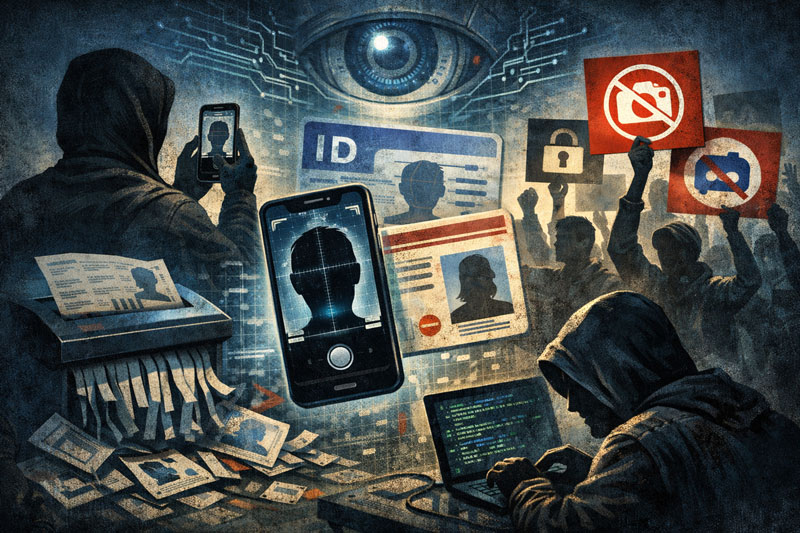

Trauma Kebocoran Data Kembali Menghantui

Alih-alih meyakinkan publik, kebijakan ini justru memicu kekhawatiran luas. Di media sosial, banyak pengguna mempertanyakan apakah Discord layak dipercaya menyimpan data sensitif, mengingat perusahaan itu baru saja mengalami kebocoran data verifikasi usia.

Pada Oktober lalu, peretas mencuri salinan kartu identitas milik sekitar 70 ribu pengguna Discord dari layanan pihak ketiga yang sebelumnya dipercaya untuk proses verifikasi usia di Inggris dan Australia. Saat itu, Discord mengakui para peretas diduga berniat memeras perusahaan dengan data curian tersebut.

Peringatan keras pun muncul dari kalangan pakar keamanan siber. Editor senior keamanan Ars Technica, Dan Goodin, kala itu menyebut pengguna yang pernah mengunggah kartu identitas sebaiknya menganggap data mereka “sudah atau akan segera dicuri, lalu dijual atau digunakan untuk pemerasan.”

Kini, kekhawatiran serupa kembali mencuat. Bagi sebagian pengguna, kebijakan baru ini justru berpotensi menjadikan Discord target yang semakin menggiurkan bagi pelaku kejahatan siber karena menghimpun lebih banyak data sensitif dalam skala global.

“Ini Cara Discord Mati”

Tak lama setelah kebijakan ini diberitakan, ratusan pengguna meluapkan kemarahan di Reddit. Di sebuah forum gim PC yang membahas alternatif Discord, seorang pengguna menulis, “Discord sudah pernah bocor data ID. Kenapa masih ada yang mau verifikasi lagi?”

Komentar lain bahkan lebih tajam. “Inilah cara Discord mati. Mengunggah identitas ke perusahaan pihak ketiga sama saja mengundang pencurian identitas dalam skala global,” tulis seorang pengguna.

Kecurigaan tak hanya tertuju pada dokumen identitas. Banyak pengguna juga menolak keras permintaan pemindaian wajah. Di subreddit aplikasi Discord, sebagian pengguna bersumpah tidak akan pernah mengirim selfie atau KTP, karena menganggap kebocoran data hanya tinggal menunggu waktu. Mereka menilai Discord mengecilkan risiko privasi demi mengumpulkan data.

Janji Keamanan dan Mitra Baru

Discord menyatakan data verifikasi usia hanya dapat diakses oleh pengguna dan tidak akan keluar dari perangkat. Untuk memulihkan kepercayaan pascakejadian Oktober, Discord kini menggandeng k-ID, penyedia layanan verifikasi usia yang juga digunakan platform besar seperti Meta dan Snap.

Namun, penjelasan itu belum sepenuhnya menenangkan pengguna. Sejumlah pengguna Reddit bahkan membedah kebijakan privasi k-ID dan menilai redaksinya ambigu.

“Bahasanya tidak jelas dan saling bertentangan. Di satu sisi bilang data dihapus, di sisi lain menyebut ‘pihak ketiga tepercaya’ yang terlibat,” tulis seorang pengguna, yang menyimpulkan bahwa rantai kebijakan privasi tersebut terkesan saling melempar tanggung jawab.

Penelusuran Ars Technica menunjukkan bahwa teknologi estimasi usia k-ID menggunakan layanan perusahaan Swiss bernama Privately. Dalam kebijakan privasinya, k-ID menyebut tidak melihat wajah pengguna yang diproses sistem. Namun, pernyataan itu dinilai masih menyisakan ruang tafsir, karena tidak secara eksplisit menyebut peran Privately.

Menanggapi pertanyaan Ars, juru bicara k-ID menegaskan bahwa teknologi estimasi usia berjalan sepenuhnya di perangkat pengguna secara real time. Tidak ada video atau gambar yang dikirim, dan satu-satunya data yang keluar dari perangkat hanyalah hasil lulus atau gagal verifikasi usia.

Privately sendiri mengklaim teknologinya dirancang sesuai prinsip perlindungan data Uni Eropa, dengan pemrosesan AI langsung di perangkat tanpa mengandalkan penyimpanan cloud dan tanpa menangkap data biometrik pengguna.

Risiko Akurasi dan Potensi Eksodus Pengguna

Discord mengakui bahwa kebijakan ini berpotensi membuat sebagian pengguna meninggalkan platform. Kepala kebijakan produk global Discord, Savannah Badalich, menyebut perusahaan juga menggunakan model inferensi usia berbasis metadata, seperti aktivitas pengguna dan pola perilaku, untuk menghindari verifikasi tambahan jika sistem yakin pengguna sudah dewasa.

Namun, kritik tetap berdatangan. Sejumlah pengguna menilai sistem verifikasi usia mudah diakali, sehingga justru memaksa pengguna dewasa menyerahkan data sensitif tanpa benar-benar melindungi anak di bawah umur. Di Australia, beberapa remaja mengaku berhasil mengelabui sistem hanya dengan mengubah tampilan wajah atau menggunakan video AI.

Di sisi lain, para ahli menilai teknologi estimasi usia masih memiliki keterbatasan serius, terutama dalam membedakan usia remaja yang berada di ambang batas legal.

Dengan rekam jejak kebocoran data dan keakuratan teknologi yang masih dipertanyakan, kebijakan verifikasi usia Discord kini berada di persimpangan: antara upaya perlindungan pengguna muda dan risiko kehilangan kepercayaan komunitasnya sendiri. (***)